Nexia

| Описание | Веб-приложение, отслеживающее популярные посты с платформы Reddit. |

| Область знаний | Программирование на Python, Работа с API, Веб-технологии |

| Близкие рецепту понятия | Лента, популярное, новости |

| Среды и средства для приготовления рецепта | Python, Visual studio code |

Сайт по сбору популярных статей Reddit

Автор: Харламова Анна

Группа: АДЭУ-221

Дисциплина: Работа с API социальных сетей и визуализация данных

Статус проекта: Выполнен

Введение

🎯 Целью данной работы является разработка веб-приложения на основе FastAPI, предназначенного для автоматического сбора, обработки и предоставления пользователю популярных постов из Reddit и актуальных новостей с Hacker News. Приложение должно обеспечивать удобный доступ к агрегированному контенту через API и веб-интерфейс.

💡 Основная идея проекта — упростить доступ пользователей к актуальному и популярному контенту Reddit в удобном и структурированном виде.

Задачи проекта:

- Изучить работу внешних API (Reddit и Hacker News).

- Реализовать клиент для получения постов и комментариев с Reddit.

- Реализовать клиент для получения новостей с Hacker News.

- Создать API-эндпоинты для: получения постов, получения новостей, получения комментариев.

- Организовать обработку и структурирование данных (JSON-формат).

- Реализовать логирование работы приложения.

- Обеспечить обработку ошибок при работе с внешними сервисами.

- Подключить статические файлы для отображения пользовательского интерфейса.

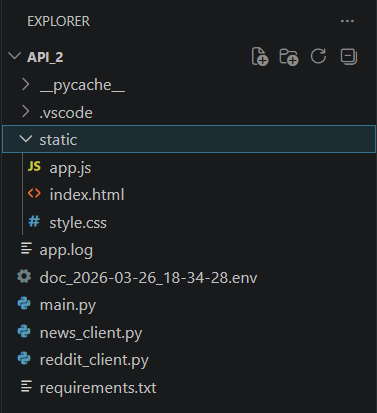

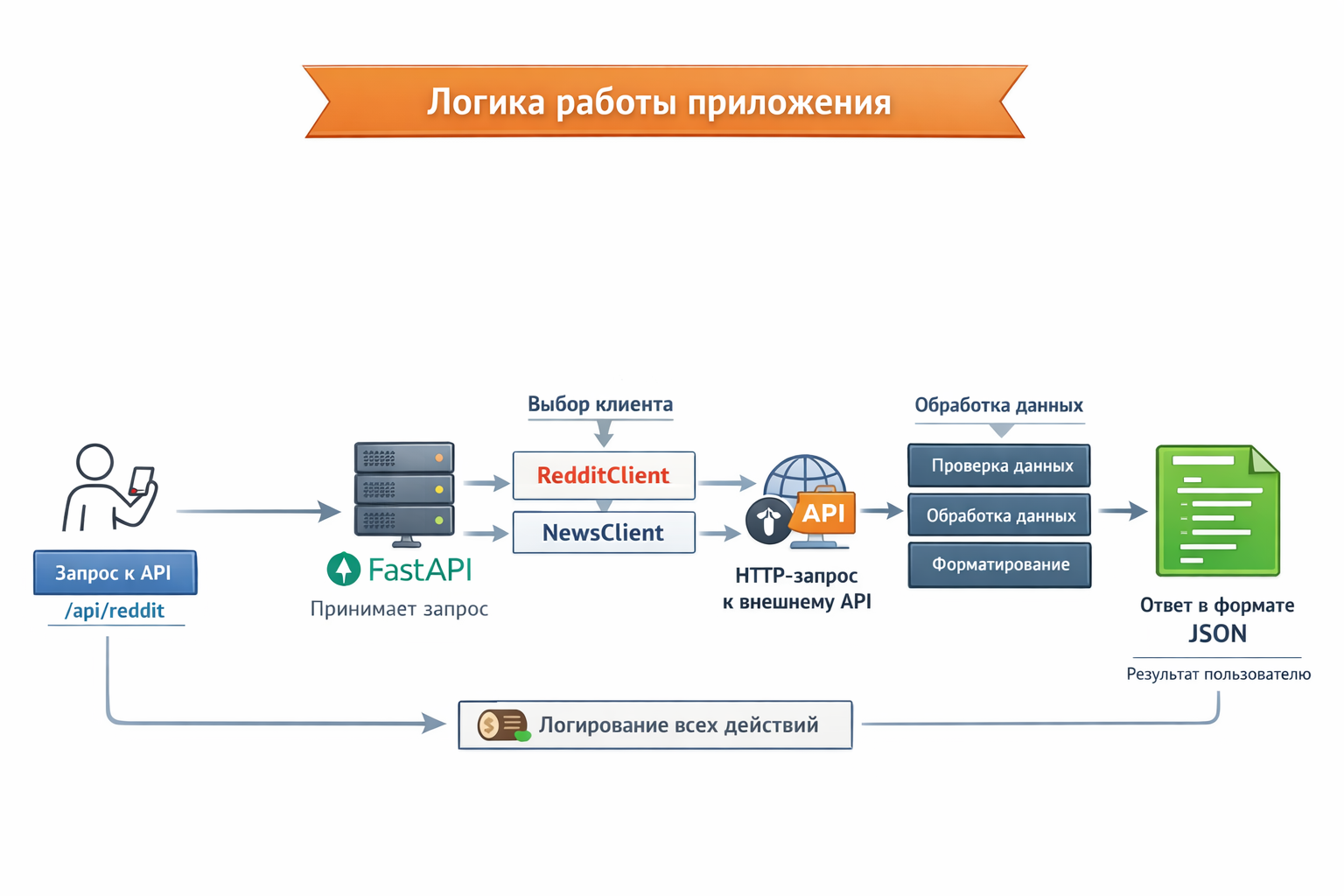

🏗 Архитектура и блок-схема проекта

Архитектура построена по принципу клиент-серверной модели и включает несколько уровней:

- Реализован через статические файлы (static)

- Отображает данные пользователю

- Отправляет HTTP-запросы к серверу

- Обработка HTTP-запросов

- Маршрутизация (/api/reddit, /api/news, /api/comments)

- Возврат данных в формате JSON

- Логирование

- RedditClient

- NewsClient

- Reddit API

- Hacker News API

- Переменные окружения (.env)

- Логирование (logging)

- HTTP-клиент (requests)

- ASGI-сервер Uvicorn

Python-структура:

import os

import logging

from fastapi import FastAPI, Query

from fastapi.staticfiles import StaticFiles

from dotenv import load_dotenv

from reddit_client import RedditClient

from news_client import NewsClient

load_dotenv()

log_level = os.getenv("LOG_LEVEL", "INFO")

logging.basicConfig(

level=log_level,

format="%(asctime)s - %(name)s - %(levelname)s - %(message)s",

handlers=[

logging.StreamHandler(),

logging.FileHandler("app.log", encoding="utf-8")

]

)

logger = logging.getLogger(__name__)

app = FastAPI(title="Nexia API")

@app.on_event("startup")

async def startup_event():

logger.info("Application starting up...")

@app.get("/api/reddit")

async def get_reddit_feed(subreddit: str = Query("popular", description="Subreddit name")):

logger.info(f"API request received for /api/reddit, subreddit: {subreddit}")

limit = int(os.getenv("REDDIT_LIMIT", "15"))

client = RedditClient(limit=limit)

result = client.fetch_posts(subreddit)

if "error" in result:

return {"status": "error", "message": result["error"]}

return {"status": "success", "data": result["posts"]}

@app.get("/api/news")

async def get_news_feed():

logger.info("API request received for /api/news")

client = NewsClient()

news = client.fetch_latest_news(limit=15)

return {"status": "success", "data": news}

@app.get("/api/comments")

async def get_comments(source: str = Query(..., description="Source network (e.g. reddit)"),

post_id: str = Query(..., description="Post ID")):

logger.info(f"API request received for /api/comments, source: {source}, id: {post_id}")

if source == 'reddit':

client = RedditClient()

comments = client.fetch_comments(post_id)

return {"status": "success", "data": comments}

# News comments aren't supported in this iteration

return {"status": "error", "message": "Comments not supported for this source."}

app.mount("/", StaticFiles(directory="static", html=True), name="static")

if __name__ == "__main__":

import uvicorn

logger.info("Starting uvicorn server on port 8000")

uvicorn.run(app, host="0.0.0.0", port=8000)

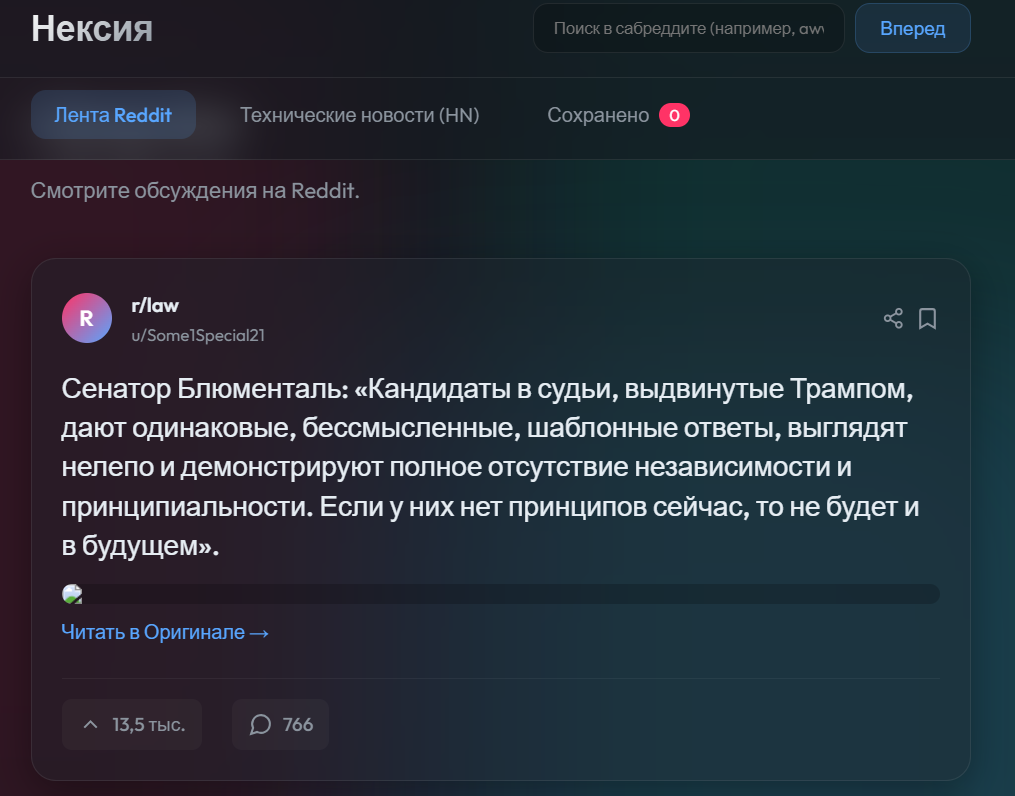

Пример вывода новостей:

Выводы о проделанной работе:

В ходе выполнения проекта разработано веб-приложение на FastAPI, агрегирующее данные из Reddit и Hacker News. Реализованы API-эндпоинты, обработка данных и клиент-серверная архитектура. Поставленная цель достигнута, приложение успешно выполняет сбор и предоставление актуального контента.

В процессе разработки:

- Освоен фреймворк FastAPI для создания API.

- Реализовано взаимодействие с внешними REST API.

- Разработана клиент-серверная архитектура.

- Настроено логирование и обработка ошибок.

- Выполнено структурирование и преобразование данных.

2. Разработанное приложение:

- Автоматизирует получение популярных постов и новостей.

- Предоставляет единый интерфейс доступа к данным.

- Может быть масштабировано и расширено.